Co to jest plik Robots.txt? Wszystko, czego potrzebujesz, aby napisać, przesłać i ponownie zaindeksować plik Robots pod kątem SEO

Napisaliśmy obszerny artykuł na ten temat w jaki sposób wyszukiwarki znajdują, przeszukują i indeksują Twoje witryny internetowe. Podstawowym krokiem w tym procesie jest robots.txt plik, brama dla wyszukiwarki umożliwiającej indeksowanie Twojej witryny. Zrozumienie, jak prawidłowo skonstruować plik robots.txt, jest niezbędne w optymalizacji wyszukiwarek (SEO).

To proste, ale potężne narzędzie pomaga webmasterom kontrolować sposób, w jaki wyszukiwarki współdziałają z ich witrynami internetowymi. Zrozumienie i efektywne wykorzystanie pliku robots.txt jest niezbędne do zapewnienia skutecznego indeksowania witryny i optymalnej widoczności w wynikach wyszukiwania.

Co to jest plik Robots.txt?

Plik robots.txt to plik tekstowy znajdujący się w katalogu głównym witryny internetowej. Jego głównym celem jest wskazanie robotom indeksującym wyszukiwarek, które części witryny powinny, a które nie powinny być przeszukiwane i indeksowane. Plik wykorzystuje protokół wykluczania robotów (REP), standardowy sposób, w jaki strony internetowe komunikują się z robotami sieciowymi i innymi robotami internetowymi.

REP nie jest oficjalnym standardem internetowym, ale jest powszechnie akceptowany i obsługiwany przez główne wyszukiwarki. Najbliższa przyjętemu standardowi jest dokumentacja głównych wyszukiwarek, takich jak Google, Bing i Yandex. Aby uzyskać więcej informacji, odwiedź Specyfikacje pliku Robots.txt firmy Google jest polecany.

Dlaczego plik Robots.txt ma kluczowe znaczenie dla SEO?

- Kontrolowane indeksowanie: Plik Robots.txt umożliwia właścicielom witryn blokowanie wyszukiwarkom dostępu do określonych sekcji ich witryn. Jest to szczególnie przydatne w przypadku wykluczania zduplikowanych treści, obszarów prywatnych lub sekcji zawierających poufne informacje.

- Zoptymalizowany budżet indeksowania: Wyszukiwarki przydzielają budżet indeksowania dla każdej witryny internetowej, czyli liczbę stron, które bot wyszukiwarki przeszuka w witrynie. Blokując nieistotne lub mniej ważne sekcje, plik robots.txt pomaga zoptymalizować budżet indeksowania, zapewniając przeszukiwanie i indeksowanie ważniejszych stron.

- Poprawiony czas ładowania witryny: Uniemożliwiając botom dostęp do nieistotnych zasobów, plik robots.txt może zmniejszyć obciążenie serwera, potencjalnie skracając czas ładowania witryny, co jest kluczowym czynnikiem SEO.

- Zapobieganie indeksowaniu stron niepublicznych: Pomaga zapobiegać indeksowaniu i wyświetlaniu obszarów niepublicznych (takich jak miejsca testowe lub obszary rozwojowe) w wynikach wyszukiwania.

Podstawowe polecenia w pliku Robots.txt i ich zastosowania

- Dopuszczać: Ta dyrektywa służy do określenia, do których stron lub sekcji serwisu roboty powinny uzyskać dostęp. Na przykład, jeśli witryna internetowa zawiera sekcję szczególnie odpowiednią dla SEO, polecenie „Zezwalaj” może zapewnić jej zaindeksowanie.

Allow: /public/- Disallow: W przeciwieństwie do „Zezwalaj” polecenie to instruuje roboty wyszukiwarek, aby nie przeszukiwały określonych części witryny. Jest to przydatne w przypadku stron bez wartości SEO, takich jak strony logowania lub pliki skryptów.

Disallow: /private/- Symbole wieloznaczne: Symbole wieloznaczne służą do dopasowywania wzorców. Gwiazdka (*) oznacza dowolną sekwencję znaków, a znak dolara ($) oznacza koniec adresu URL. Są one przydatne do określania szerokiego zakresu adresów URL.

Disallow: /*.pdf$- Mapy witryn: Dołączenie lokalizacji mapy witryny do pliku robots.txt pomaga wyszukiwarkom znaleźć i zaindeksować wszystkie ważne strony w witrynie. Ma to kluczowe znaczenie dla SEO, ponieważ pomaga w szybszym i pełniejszym indeksowaniu witryny.

Sitemap: https://martech.zone/sitemap_index.xmlDodatkowe polecenia w pliku Robots.txt i ich zastosowania

- Agent użytkownika: Określ, którego przeszukiwacza dotyczy reguła. „User-agent: *” stosuje regułę do wszystkich robotów. Przykład:

User-agent: Googlebot- Noindeks: Chociaż nie jest to część standardowego protokołu pliku robots.txt, niektóre wyszukiwarki rozumieją: noindex dyrektywa w pliku robots.txt jako instrukcja, aby nie indeksować określonego adresu URL.

Noindex: /non-public-page/- Opóźnienie indeksowania: To polecenie prosi roboty indeksujące o odczekanie określonej ilości czasu pomiędzy trafieniami na serwer, co jest przydatne w przypadku witryn z problemami z obciążeniem serwera.

Crawl-delay: 10Jak przetestować plik Robots.txt

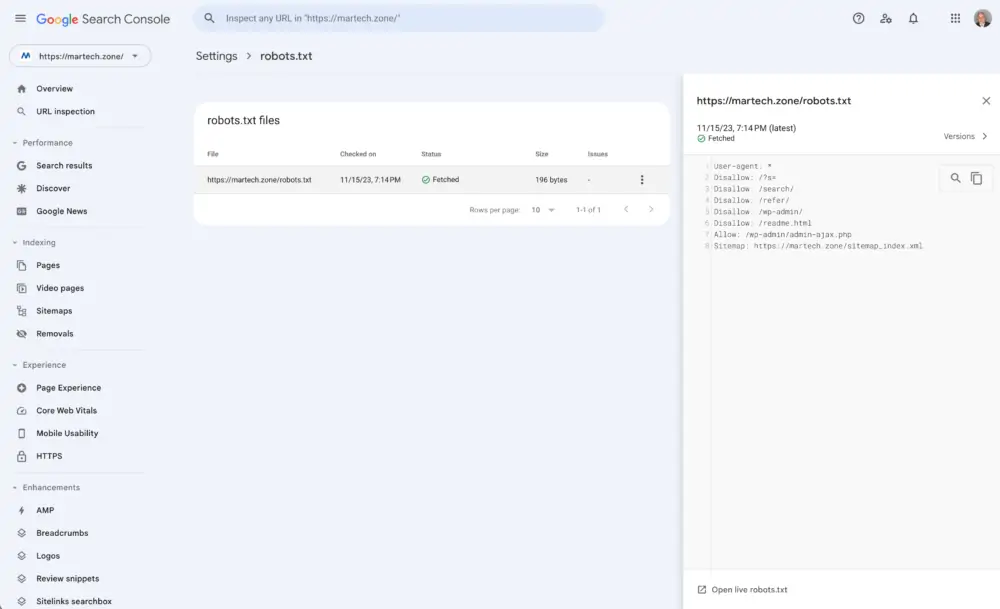

Chociaż jest zakopane Konsola wyszukiwania Google, konsola wyszukiwania oferuje tester pliku robots.txt.

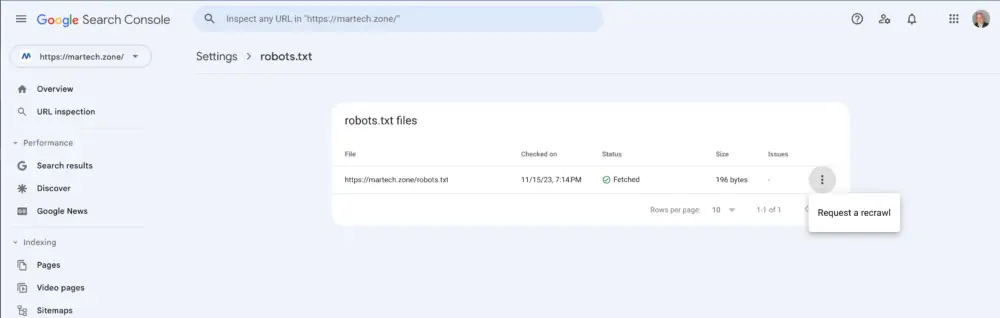

Możesz także ponownie przesłać plik Robots.txt, klikając trzy kropki po prawej stronie i wybierając Poproś o ponowne indeksowanie.

Przetestuj lub prześlij ponownie plik Robots.txt

Czy plik Robots.txt może służyć do kontrolowania botów AI?

W pliku robots.txt można określić, czy AI boty, w tym roboty indeksujące i inne automatyczne boty, mogą przeszukiwać lub wykorzystywać zawartość Twojej witryny. Plik kieruje tymi botami, wskazując, do których części witryny internetowej mogą uzyskać dostęp, a do których nie. Skuteczność pliku robots.txt kontrolującego zachowanie botów AI zależy od kilku czynników:

- Przestrzeganie protokołu: Większość renomowanych robotów wyszukiwarek i wiele innych botów AI przestrzega określonych zasad

robots.txt. Należy jednak pamiętać, że plik ten jest bardziej prośbą niż możliwym do wyegzekwowania ograniczeniem. Boty mogą ignorować te żądania, zwłaszcza te obsługiwane przez mniej skrupulatne podmioty. - Specyfika instrukcji: Możesz określić różne instrukcje dla różnych botów. Na przykład możesz zezwolić określonym botom AI na indeksowanie Twojej witryny, uniemożliwiając innym. Odbywa się to za pomocą

User-agentdyrektywa wrobots.txtprzykład pliku powyżej. Na przykład,User-agent: Googlebotokreśla instrukcje dla robota Google, natomiastUser-agent: *dotyczyłoby wszystkich botów. - Ograniczenia: Kompletujemy wszystkie dokumenty (wymagana jest kopia paszportu i XNUMX zdjęcia) potrzebne do

robots.txtmoże uniemożliwić botom indeksowanie określonej treści; nie ukrywa przed nimi treści, jeśli już je znają URL. Ponadto nie zapewnia żadnych możliwości ograniczenia wykorzystania treści po jej przeszukaniu. Jeśli wymagana jest ochrona treści lub określone ograniczenia użytkowania, konieczne mogą być inne metody, takie jak ochrona hasłem lub bardziej wyrafinowane mechanizmy kontroli dostępu. - Rodzaje botów: Nie wszystkie boty AI są powiązane z wyszukiwarkami. Różne boty są wykorzystywane do różnych celów (np. agregacja danych, analityka, przeglądanie treści). Plik robots.txt może być również używany do zarządzania dostępem różnych typów botów, o ile są one zgodne z REP.

Połączenia robots.txt plik może być skutecznym narzędziem do sygnalizowania Twoich preferencji dotyczących przeszukiwania i wykorzystywania zawartości witryny przez boty AI. Jednak jego możliwości ograniczają się do dostarczania wytycznych, a nie egzekwowania ścisłej kontroli dostępu, a jego skuteczność zależy od zgodności botów z Protokołem wykluczania robotów.

Plik robots.txt to małe, ale potężne narzędzie w arsenale SEO. Prawidłowe użycie może znacząco wpłynąć na widoczność witryny i wydajność wyszukiwarek. Kontrolując, które części witryny są przeszukiwane i indeksowane, webmasterzy mogą zapewnić wyróżnienie ich najcenniejszych treści, poprawiając wysiłki związane z SEO i wydajnością witryny.